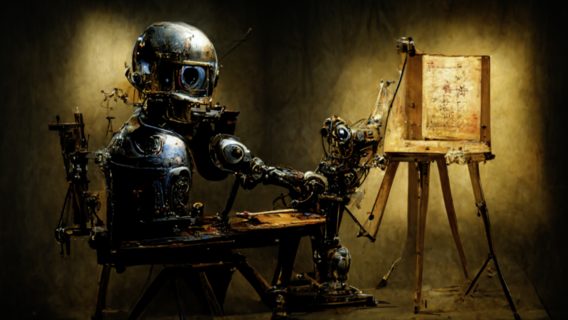

Отрута для ШІ. В Чиказькому університеті придумали ПЗ, щоб штучний інтелект не міг використовувати твори мистецтва для самонавчання

«Це як додати гострий соус в обід, щоб його не вкрали з холодильника на робочому місці».

«Це як додати гострий соус в обід, щоб його не вкрали з холодильника на робочому місці».

«Це як додати гострий соус в обід, щоб його не вкрали з холодильника на робочому місці».

В Чиказькому університеті розробили програмне забезпечення Nightshade, яке «отруює» дані зображень, перешкоджаючи навчанню ШІ-моделей.

Бен Чжао, професор комп’ютерних наук, який очолив проєкт, порівняв Nightshade з «додаванням гострого соусу в обід, щоб його не вкрали з холодильника на робочому місці».

Nightshade змінює пікселі на зображеннях, щоб змусити ШІ-моделі інтерпретувати їх не так, як бачить людина в реальному світі. Штучний інтелект неправильно класифікує ознаки «заштрихованих» зображень. Повідомляється, що для спотворення підказок для Stable Diffusion (нейромережа, яка перетворює текст в зображення — ред.) може знадобитися менше 100 «отруєних» зразків.

Ось як це виглядає для людини і ШІ:

«Отруєний» зразок картини ШІ «побачить» у вигляді кота в халаті.

Бен Чжао каже, що Nightshade абсолютно легальний інструмент. Його кінцева мета — стягувати додаткову ціну за кожен фрагмент даних, вилучених ШІ без дозволу. В ідеалі, компаніям доведеться ліцензувати збір даних для навчання своїх моделей, гарантуючи, що художники дадуть на це згоду і отримають компенсацію за свою роботу.